python爬虫 urllib模块url编码处理详解

案例:爬取使用搜狗根据指定词条搜索到的页面数据(例如爬取词条为‘周杰伦'的页面数据)

import urllib.request

# 1.指定url

url = 'https://www.sogou.com/web?query=周杰伦'

'''

2.发起请求:使用urlopen函数对指定的url发起请求,

该函数返回一个响应对象,urlopen代表打开url

'''

response = urllib.request.urlopen(url=url)

# 3.获取响应对象中的页面数据:read函数可以获取响应对象中存储的页面数据(byte类型的数据值)

page_text = response.read()

# 4.持久化存储:将爬取的页面数据写入文件进行保存

with open("sougou.html","wb") as f:

f.write(page_text)

print("写入数据成功")

f.close()

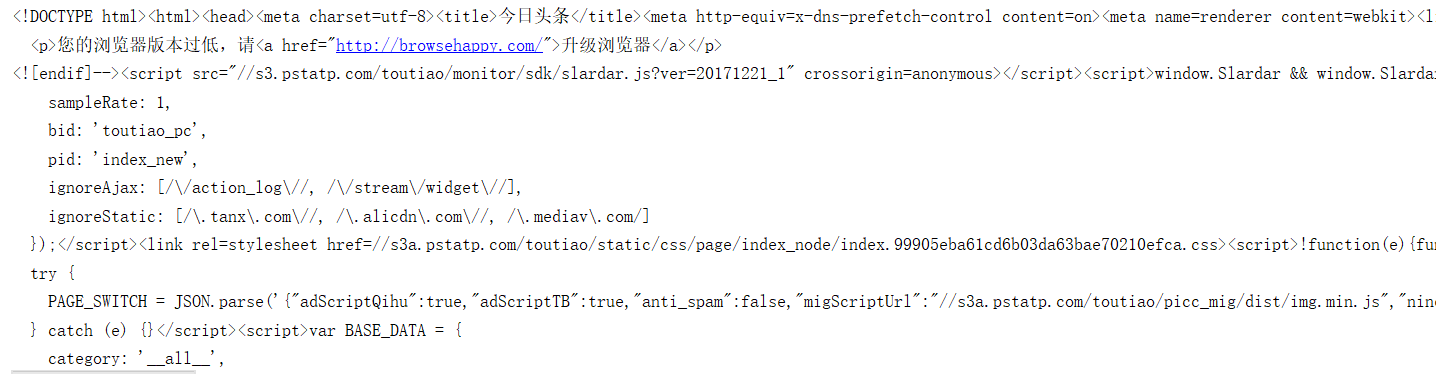

编码错误

【注意】上述代码中url存在非ascii编码的数据,则该url无效。如果对其发起请求,则会报如下错误:

UnicodeEncodeError: 'ascii' codec can't encode characters in position 15-17: ordinal not in range(128)

url的特性:url不可以存在非ASCII编码字符数据,url必须为ASCII编码的数据值。所以我们在爬虫代码中编写url时,如果url中存在非ASCII编码的数据值,则必须对其进行ASCII编码后,该url方可被使用。

上面的“周杰伦” 不是ASCII编码字符数据,所以url就会变成无效的url,不符合url特性,所以报错误

所以必须对url中的非ascii的数据进行ascii的编码,则该url方可被发起请求:

需要用到 urllib.parse

方法 1:使用quote函数

quote函数作用:对url中所存在的特殊字符进行ASCII的编码,把url中的非ascii编码的字符单独取出来,使用quote函数进行转码,

转码之后,把转码的结果拼接到原有的url当中。

import urllib.request

import urllib.parse

# 1.指定url

url = 'https://www.sogou.com/web?query=周杰伦'

word = urllib.parse.quote("周杰伦")

# 查看转码后结果

print(word)

# %E5%91%A8%E6%9D%B0%E4%BC%A6

from urllib.request import urlopen

import urllib.parse

# 1.指定url

url = 'https://www.sogou.com/web?query='

# url的特性:url不可以存在非ASCII编码字符数据

word = urllib.parse.quote("周杰伦")

# 将编码后的数据值拼接回url中

url = url+word # 有效url

'''

2.发起请求:使用urlopen函数对指定的url发起请求,

该函数返回一个响应对象,urlopen代表打开url

'''

response = urlopen(url=url)

# 3.获取响应对象中的页面数据:read函数可以获取响应对象中存储的页面数据(byte类型的数据值)

page_text = response.read()

# 4.持久化存储:将爬取的页面数据写入文件进行保存

with open("周杰伦.html","wb") as f:

f.write(page_text)

print("写入数据成功")

以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持【听图阁-专注于Python设计】。