解决python爬虫中有中文的url问题

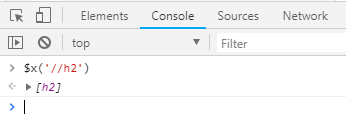

如果URL中存在中文,而你却不对它做任何处理,他不会达到你所想的那样,因此我们需要将中文部分进行处理,要用到urllib.parse模块中的quote将中文转化成URL所需的编码,url中的中文要单独处理,不能中英文全部合在一起处理(因为一部分的特殊字符也会被处理掉)。

import urllib.parse word='龙' word=urllib.parse.quote(word) url='https://baike.baidu.com/search/word?word=%s'%word print(url)

运行结果为:

以上这篇解决python爬虫中有中文的url问题就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支持【听图阁-专注于Python设计】。