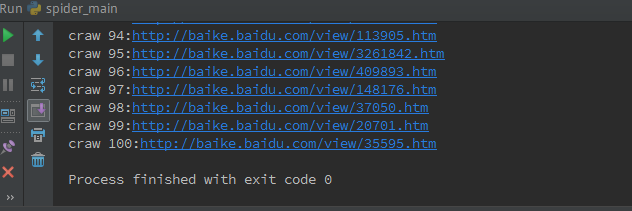

python爬虫自动创建文件夹的功能

该爬虫应用了创建文件夹的功能:

#file setting folder_path = "D:/spider_things/2016.4.6/" + file_name +"/" if not os.path.exists(folder_path): os.makedirs(folder_path)

上面代码块的意思是:

"os.path.exists(folder_path)"用来判断folder_path这个路径是否存在,如果不存在,就执行“os.makedirs(folder_path)”来创建这个路径

补充:下面看下Python 爬虫 —— 文件及文件夹操作

0. 文件名、路径信息、拓展名等

#取文件后缀

>>> os.path.splitext("/root/a.py")

('/root/a', '.py')

#取目录与文件名

>>> os.path.split("/root/a.py")

('/root', 'a.py')

>>> os.path.basename("/root/a.py")

'a.py'

>>> os.path.dirname('/root/a.py')

'/root'

1. 遍历文件夹及重命名

import os

import sys

path = 'D:/emojis'

# os.walk 返回的是一个三元组

for (path, dirs, files) in os.walk(path):

for filename in files:

newname = "emoji_" +filename

os.rename(os.path.join(path, filename) , os.path.join(path, new_name))

总结

以上所述是小编给大家介绍的python爬虫自动创建文件夹的功能,希望对大家有所帮助,如果大家有任何疑问请给我留言,小编会及时回复大家的。在此也非常感谢大家对【听图阁-专注于Python设计】网站的支持!