spark: RDD与DataFrame之间的相互转换方法

DataFrame是一个组织成命名列的数据集。它在概念上等同于关系数据库中的表或R/Python中的数据框架,但其经过了优化。DataFrames可以从各种各样的源构建,例如:结构化数据文件,Hive中的表,外部数据库或现有RDD。

DataFrame API 可以被Scala,Java,Python和R调用。

在Scala和Java中,DataFrame由Rows的数据集表示。

在Scala API中,DataFrame只是一个类型别名Dataset[Row]。而在Java API中,用户需要Dataset<Row>用来表示DataFrame。

在本文档中,我们经常将Scala/Java数据集Row称为DataFrames。

那么DataFrame和spark核心数据结构RDD之间怎么进行转换呢?

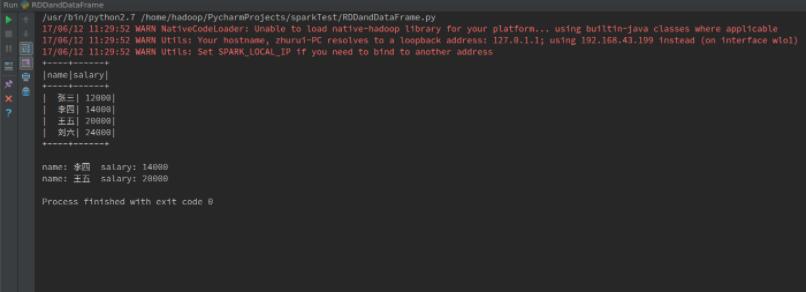

代码如下:

# -*- coding: utf-8 -*-

from __future__ import print_function

from pyspark.sql import SparkSession

from pyspark.sql import Row

if __name__ == "__main__":

# 初始化SparkSession

spark = SparkSession \

.builder \

.appName("RDD_and_DataFrame") \

.config("spark.some.config.option", "some-value") \

.getOrCreate()

sc = spark.sparkContext

lines = sc.textFile("employee.txt")

parts = lines.map(lambda l: l.split(","))

employee = parts.map(lambda p: Row(name=p[0], salary=int(p[1])))

#RDD转换成DataFrame

employee_temp = spark.createDataFrame(employee)

#显示DataFrame数据

employee_temp.show()

#创建视图

employee_temp.createOrReplaceTempView("employee")

#过滤数据

employee_result = spark.sql("SELECT name,salary FROM employee WHERE salary >= 14000 AND salary <= 20000")

# DataFrame转换成RDD

result = employee_result.rdd.map(lambda p: "name: " + p.name + " salary: " + str(p.salary)).collect()

#打印RDD数据

for n in result:

print(n)

以上这篇spark: RDD与DataFrame之间的相互转换方法就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支持【听图阁-专注于Python设计】。